更多相关内容

什么是 IB 交换机(InfiniBand Switch)

InfiniBand交换机是一种高速网络交换机,它采用了InfiniBand技术,一种面向高性能计算和数据中心的网络协议,来实现高性能、低延迟和高带宽的数据传输,可为计算机到计算机的数据互连提供卓越的吞吐量和最小的延迟。它既用作服务器和存储系统之间的直接或交换互连,也用作存储系统之间的互连,传输速度通常在Gbps至Tbps之间,比传统的以太网和Fibre Channel协议要快得多。

InfiniBand交换机通常用于高性能计算(HPC)、数据中心、云计算和大规模存储等领域,以满足高性能计算和数据传输的需求。随着人工智能的指数级增长,InfiniBand已成为GPU服务器的首选网络互连技术。

InfiniBand的网络架构

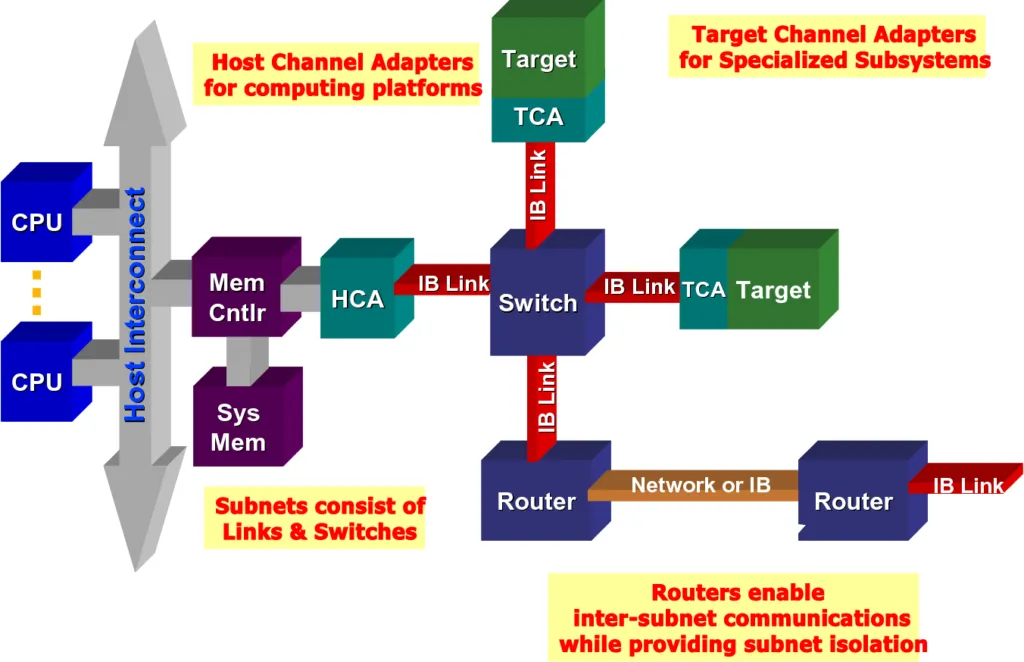

InfiniBand 是处理器和 I/O 设备之间数据流的通信链路,支持多达 64,000 个可寻址设备。 InfiniBand 架构 (IBA) 是一种行业标准规范,定义了用于互连服务器、通信基础设施、存储设备和嵌入式系统的点对点交换输入/输出框架。

InfiniBand 具有低延迟、高带宽的特点,非常适合在与数千个互连节点的单一连接中连接多个数据流(集群、通信、存储、管理)。最小的完整IBA单元是子网,多个子网通过路由器连接起来,形成一个大的IBA网络。

InfiniBand 系统由通道适配器、交换机、路由器、电缆和连接器组成。 CA 分为主机通道适配器 (HCA) 和目标通道适配器 (TCA)。 IBA交换机在原理上与其他标准网络交换机类似,但必须满足InfiniBand的高性能和低成本要求。 HCA是IB端节点(例如服务器或存储设备)连接到IB网络的设备点。 TCA 是一种特殊形式的通道适配器,主要用于嵌入式环境,例如存储设备。

HCA是IB端节点(例如服务器或存储设备)连接到IB网络的设备点。 TCA 是一种特殊形式的通道适配器,主要用于嵌入式环境,例如存储设备。

InfiniBand交换机的优势

- 低延迟:InfiniBand 网络以其极低的延迟而闻名。 RDMA 零拷贝网络减少了操作系统开销,允许数据在网络中快速移动。

- 高带宽:InfiniBand 网络提供高带宽数据传输功能。它通常支持数10Gb/s甚至更高的带宽,高带宽使得节点之间高速交换数据成为可能。

- 高吞吐量:由于低延迟和高带宽的特点,IB网络能够实现高吞吐量的数据传输。支持大规模数据流的并行传输,同时减少中间处理和复制操作

- 可扩展性:支持全局互连网络、树形结构、扁平结构等多级拓扑,可根据应用需求和规模灵活配置和扩展。

InfiniBand交换机的缺点和局限性

InfiniBand(IB)的确拥有众多优势,令人好奇的是,为什么在人工智能爆炸性发展的背景下,市场越来越多地表达出希望以太网成为人工智能工作负载的首选技术。随着时间的推移,业界发现了InfiniBand的几个致命缺点:

- 成本非常高:与以太网相比,InfiniBand 的主要缺点是价格过高。使用InfiniBand构建专用网络需要指定的IB网卡和交换机,其成本一般是普通网络设备的五到十倍。因此,InfiniBand 只被认真考虑在金融和期货交易等高端行业实施。

- 运维费用增加:InfiniBand作为专用网络技术,无法充分利用用户现有的IP网络基础设施和积累的运维知识。选择InfiniBand的企业必须聘请专门的人员来处理特定的运维需求。但由于InfiniBand所占据的市场空间有限(不到以太网的1%),行业内经验丰富的运维人员严重短缺。网络故障可能会长时间得不到修复,从而导致高昂的运营费用 (OPEX)。

- 供应商锁定:供应商锁定的存在是 InfiniBand 交换机的一个主要缺点。这些交换机由特定供应商制造并使用专有协议,这使得它们很难与使用IP以太网的其他网络设备进行通信。这种封闭的架构也给未来需要可扩展扩展的企业带来了风险,因为与单一供应商的捆绑可能会导致不可控的风险。

- 交货时间长:InfiniBand 交换机的交货时间长是另一个问题。他们的到来是不可预测的,这增加了项目风险并阻碍了业务扩展。

- 升级慢:网络的升级过程取决于各个厂商的产品版本,无法实现全行业的统一升级。这种升级缓慢会阻碍网络的整体进步。

以太网承载RDMA替代InfiniBand

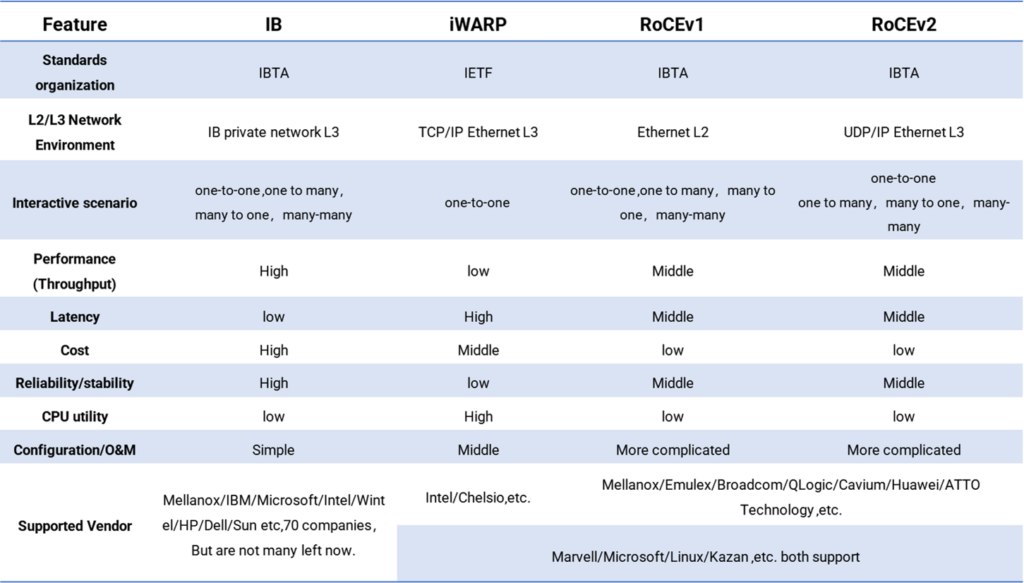

目前,存在三种类型的RDMA网络。 Infiniband是专为RDMA设计的网络,从硬件层面保证可靠传输,而RoCE和iWARP是基于以太网的RDMA技术,支持相应的Verbs接口。

RDMA首先在Infiniband传输网络上实现,技术先进但价格昂贵。后来厂商将RDMA移植到传统以太网中,降低了RDMA的使用成本,促进了RDMA技术的普及。下面是各个RDMA网络协议栈的对比,目前业界讨论较多的是RoCEv2网络,RoCEv2克服了 RoCEv1 绑定到单个 VLAN 的限制。通过更改数据包封装(包括 IP 和 UDP 头),可以跨 L2 和 L3 网络使用。

如何实现?

为了在数据中心实现以太网承载RDMA,可以安装支持RoCE的网卡驱动程序和网络适配器。对于以太网交换机,需要选择使用支持PFC(优先流控制)等支持构建无损以太网的产品;对于服务器或主机,需要使用支持RoCEv2流量的网卡。

目前提供RoCE交换机组网方案的国外供应商主要有:思科、Arista、英伟达(ConnectX 系列)、Juniper网络、Aruba (CX 交换机)、DELL (EMC OS10)

国内厂商有基于SONiC提供一站式开放网络解决方案的星融元Asterfusion (25G-400G CX-N 超低时延交换机系列)