RDMA交换机:实现高性能互联的重要设备

更多相关内容

在高性能计算和大数据处理等领域,RDMA(Remote Direct Memory Access)技术已经成为了一种重要的网络通信技术。RDMA交换机作为RDMA技术的核心设备之一,可以提供低延迟、高吞吐量、高可靠性的网络互联功能,成为了高性能互联的重要工具。

RDMA交换机的定义和功能

RDMA交换机是一种专门用于RDMA网络通信的交换机设备。它可以提供低延迟、高吞吐量、高可靠性的网络互联功能,实现高性能计算和大数据处理等应用场景中的快速数据传输和处理。

RDMA交换机的主要功能包括:

- RDMA网络通信:RDMA交换机可以实现基于RDMA的网络通信,提供低延迟、高吞吐量、高可靠性的数据传输和处理。它可以通过InfiniBand、RoCE(RDMA over Converged Ethernet)等协议,实现对RDMA网络通信的支持和管理。

- 数据转发和路由:RDMA交换机可以实现数据的转发和路由,将数据从源端点传输到目的端点。它可以通过端口映射、子网管理和路由表等方式,实现对数据的转发和路由,保证数据的可靠性和高效性。

- QoS和流量控制:RDMA交换机可以实现对网络流量的优化和管理,提高网络的性能和效率。它可以支持QoS和流量控制等功能,保证不同数据流的传输质量和优先级。

- 管理和监控:RDMA交换机可以实现对网络的管理和监控,保证网络的稳定性和可靠性。它可以提供设备状态、链路状态、流量统计等信息,并支持SNMP、CLI等管理和监控方式。

RDMA交换机的特点和优势

RDMA交换机具有以下特点和优势:

- 低延迟和高吞吐量:RDMA交换机可以实现低延迟和高吞吐量的数据传输,提高网络的响应速度和数据处理能力。它可以通过RDMA技术,直接访问内存中的数据,避免了数据复制和中间处理的过程,提高了数据传输的效率。

- 高可靠性和可扩展性:RDMA交换机可以提供高可靠性和可扩展性的网络互联功能,适用于不同规模和应用场景的网络需求。它可以通过多路径、冗余链路、多网卡等方式,实现对网络的冗余和负载均衡,提高网络的可靠性和可扩展性。

- QoS和流量控制:RDMA交换机可以支持QoS和流量控制等功能,保证不同数据流的传输质量和优先级。它可以通过配置不同的服务等级、限制带宽等方式,实现对网络流量的优化和管理,提高网络的性能和效率。

- 简单易用:RDMA交换机通常具有简单易用的特点,不需要过多的配置和管理即可实现高性能的网络互联功能。它可以通过自动配置、自动发现等功能,简化网络部署和管理的过程,提高网络的可用性和易用性。

RDMA交换机的应用场景

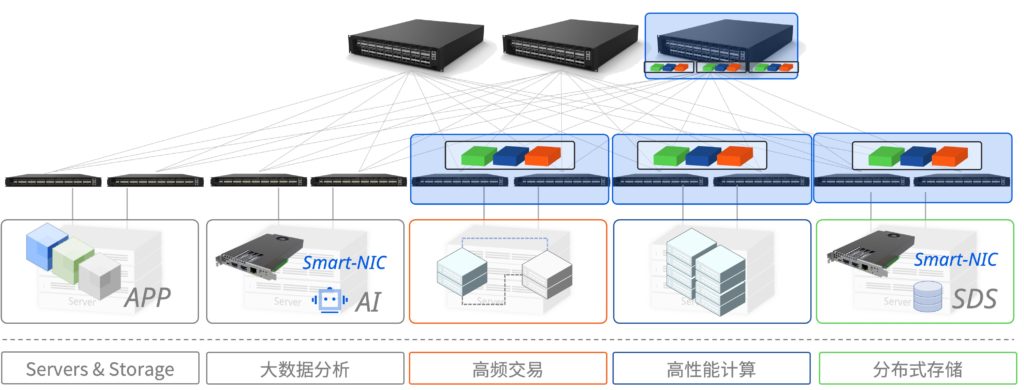

RDMA交换机广泛应用于各种高性能计算和大数据处理等领域,如超级计算机、分布式存储、云计算等。它可以通过低延迟、高吞吐量的网络互联,实现高性能的数据传输和处理,提高计算和存储系统的性能和效率。

在超级计算机中,RDMA交换机可以用于连接不同的计算节点、存储节点和网络节点,实现对超级计算机的互联和管理。通过RDMA的低延迟、高吞吐量的数据传输,可以提高超级计算机的计算能力和数据处理能力,实现高性能的科学计算和仿真等应用。

在分布式存储中,RDMA交换机可以用于连接不同的存储节点和网络节点,实现高性能的数据传输和处理。通过RDMA的低延迟、高吞吐量的数据传输,可以提高存储系统的数据处理能力和数据传输效率,满足大数据处理等应用的需求。

在云计算中,RDMA交换机可以用于连接不同的计算节点和存储节点,实现高性能的云计算服务和应用。通过RDMA的低延迟、高吞吐量的数据传输,可以提高云计算服务的性能和响应速度,提高用户体验和满意度。

总结

RDMA交换机作为高性能互联的重要设备,具有低延迟、高吞吐量、高可靠性等优势,在各种高性能计算和大数据处理等领域得到了广泛的应用。通过RDMA的网络通信和优化,RDMA交换机可以实现高性能的数据传输和处理,提升计算和存储系统的性能和效率。在高性能计算和大数据处理等领域中,选择合适的RDMA交换机设备,对于提高网络的效率和可靠性具有重要的意义。

VLAN交换机是一种专门用于VLAN划分和管理的交换机设备。它可以将网络分段隔离,实现不同VLAN之间的通信和管理。与普通交换机不同,VLAN交换机具有更高的灵活性和可配置性,可以满足不同的网络需求和应用场景。

VLAN交换机是一种专门用于VLAN划分和管理的交换机设备。它可以将网络分段隔离,实现不同VLAN之间的通信和管理。与普通交换机不同,VLAN交换机具有更高的灵活性和可配置性,可以满足不同的网络需求和应用场景。