面对AI算力需求,DCQCN如何优化数据中心网络性能?

近期文章

DCQCN ( Data Center Quantized Congestion Notification),数据中心量化拥塞通知。它是一种专门为数据中心网络设计的端到端拥塞控制协议。其核心目的是在使用RDMA(RoCEv2) 的网络中,高效地管理网络拥塞,从而保证高吞吐、低延迟和零丢包(或极低丢包)。

简单来说,DCQCN就是RDMA在以太网(RoCE)环境中的“交通警察”,它确保高速数据流不会造成网络堵塞。

本文参阅文献:Congestion Control for Large-Scale RDMA Deployments.pdf

为什么需要DCQCN?

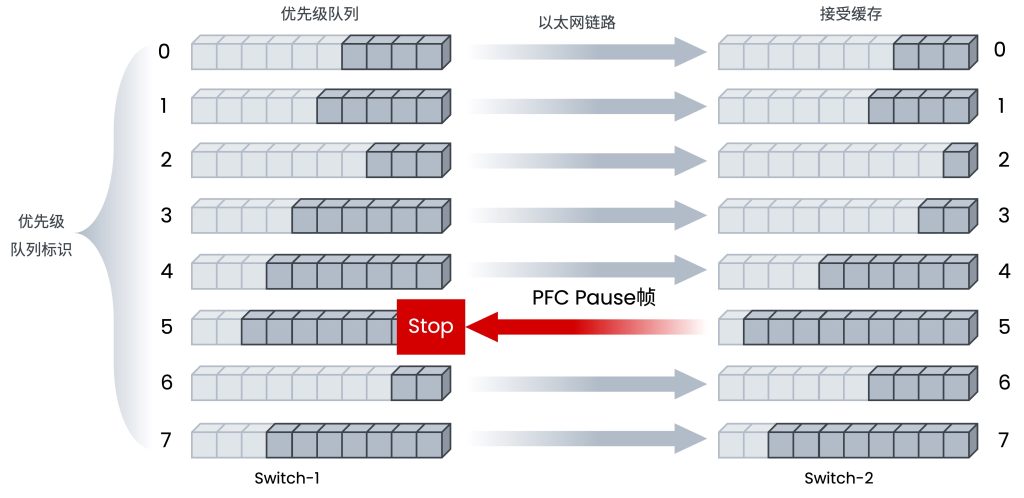

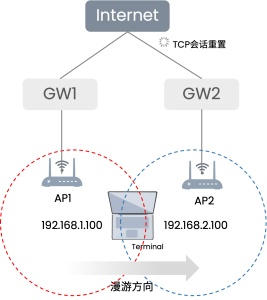

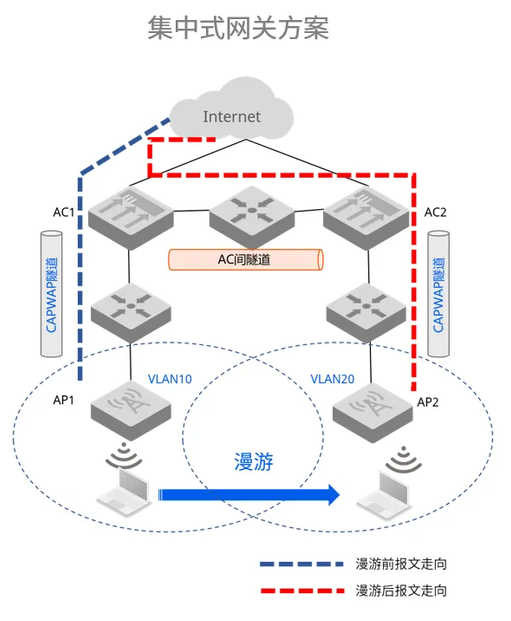

现代数据中心应用需要高吞吐量和超低延迟网络,具有低 CPU 开销。标准 TCP/IP 堆栈不能满足这些要求,但RDMA可以。在 IP 路由的数据中心网络上,RDMA 使用 RoCEv2 协议部署,该协议依赖于基于优先级的流量控制 (PFC) 可实现无中断网络。

但是,由于队头阻塞和带宽分配不均等问题,PFC 会导致应用程序性能不佳。为了缓解这些问题,DCQCN诞生了。

DCQCN是如何工作的?

DCQCN 是一种基于速率的拥塞控制协议,它模仿了著名的QCN(Quantized Congestion Notification),但做了适应数据中心的修改,更适合RDMA的高性能、低开销特性。

- 发送方:速率调节的起点(运行RDMA应用的服务器)

- 交换机:拥塞的检测和通知者(支持ECN的交换机)

- 接收方:通知的转发者(运行RDMA应用的服务器)

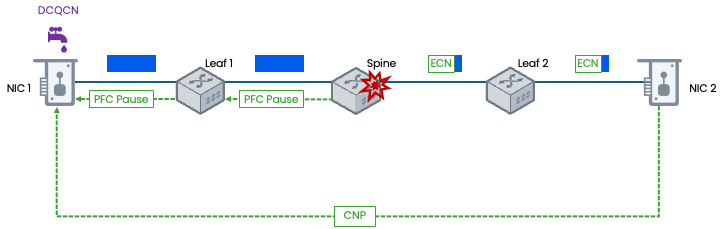

整个过程可以分为以下四个步骤:

步骤 1: 拥塞检测与标记(在交换机发生)

交换机持续监控其出口端口的队列深度。当某个端口的队列长度超过一个预设的阈值(Kmin)时,交换机判断该端口发生了拥塞。对于经过该拥塞端口的数据包,交换机会以一定概率将其IP头中的ECN(显式拥塞通知) 字段标记为“拥塞遭遇”(CE)。这个概率随着队列变长而增加。

步骤 2: 拥塞通知(接收方 -> 发送方)

被标记了ECN的数据包会继续被发送到接收方服务器。接收方的网卡识别到这个ECN标记后,不会像传统TCP一样等待ACK包,而是立即生成并发送一个名为“CNP”(Congestion Notification Packet)的特殊控制包 directly返回给发送方。

CNP包非常小(约64字节),拥有最高优先级,以确保它能最快速度地返回给发送方,几乎无延迟地报告拥塞。

步骤 3: 速率调节(在发送方发生)

发送方收到CNP包后,就知道其发出的数据流在某处造成了网络拥塞。发送方会根据内置的算法立即降低其数据发送速率(Rate)。这个降速过程是多级的:

- 快速恢复:首先进行一次大幅度的降速(乘以一个小于1的因子,如 0.5),以快速缓解网络压力。

- 主动减少:之后进入一个阶段,持续地、较小幅度地降低速率。

- 主动增加:当一段时间内没有收到新的CNP包时,发送方会认为拥塞已经解除,开始缓慢地、逐步地增加发送速率(加法增加),以重新探知可用带宽。

这个“降-增”的循环过程使得DCQCN能够动态、平滑地适应网络状态,既不会过于激进导致带宽浪费,也不会过于保守导致延迟升高。

DCQCN的应用与部署

DCQCN由Mellanox(现NVIDIA的一部分)在其网卡中实现,并广泛应用于微软等大型数据中心,以支持其云存储、分布式缓存等需要高吞吐量和低延迟的服务。由于其重要性和影响力,DCQCN在2025年获得了SIGCOMM“经典之作奖”。

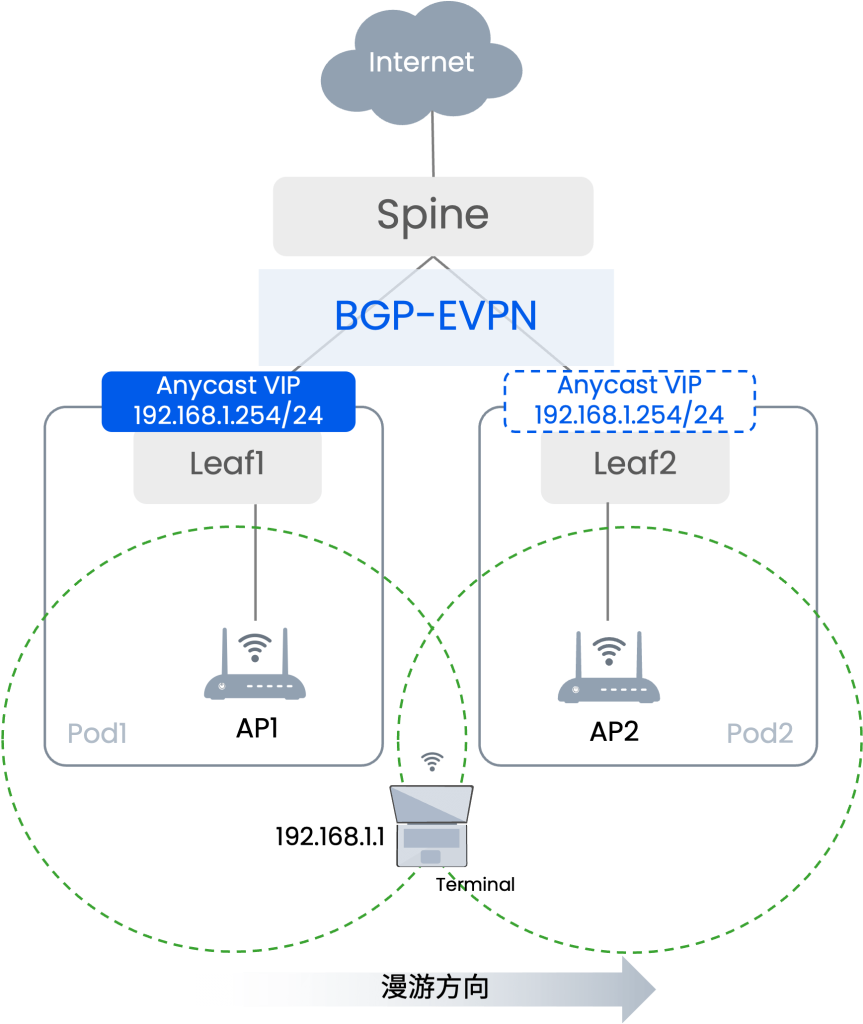

- AI与大模型训练:在数据并行、流水线并行和张量并行等分布式训练模式中,节点间需要频繁同步海量参数(通常达百GB级别)。DCQCN能有效减少网络拥塞,避免因PFC“刹停”或丢包导致的计算长尾延迟,保障训练任务高效运行。

- 高性能计算(HPC):用于需要极高网络带宽和极低延迟的科学计算、模拟等场景,DCQCN帮助RDMA实现接近线速的传输。

- 云存储与分布式系统:如微软的云存储服务,DCQCN保障了后端存储节点间大数据块传输的效率和稳定性,同时极大降低了CPU开销。

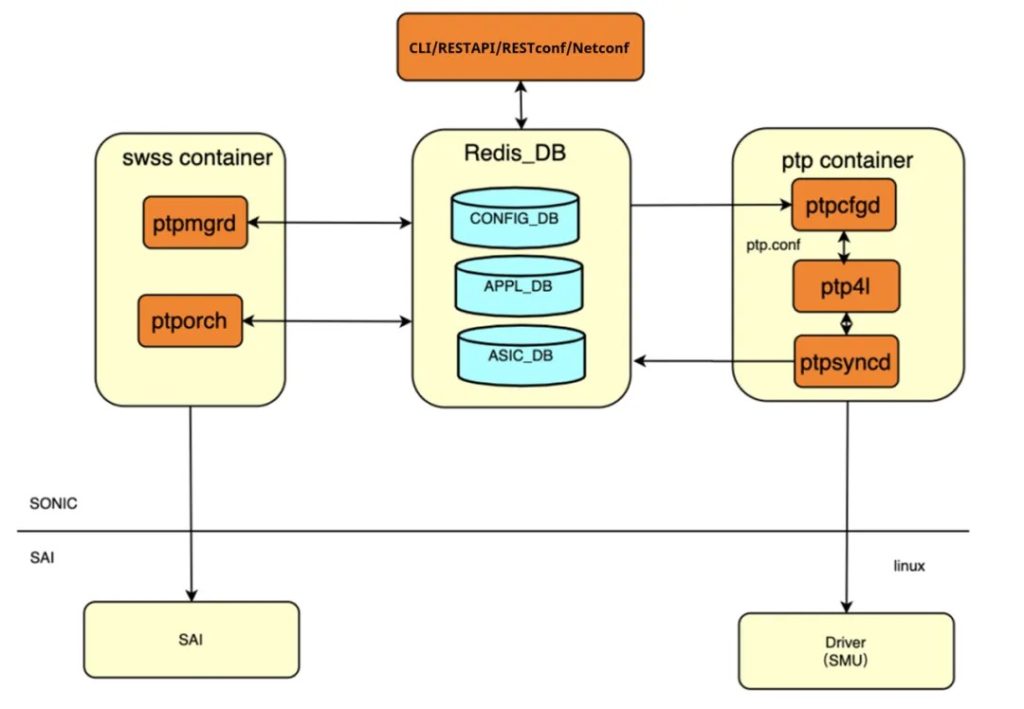

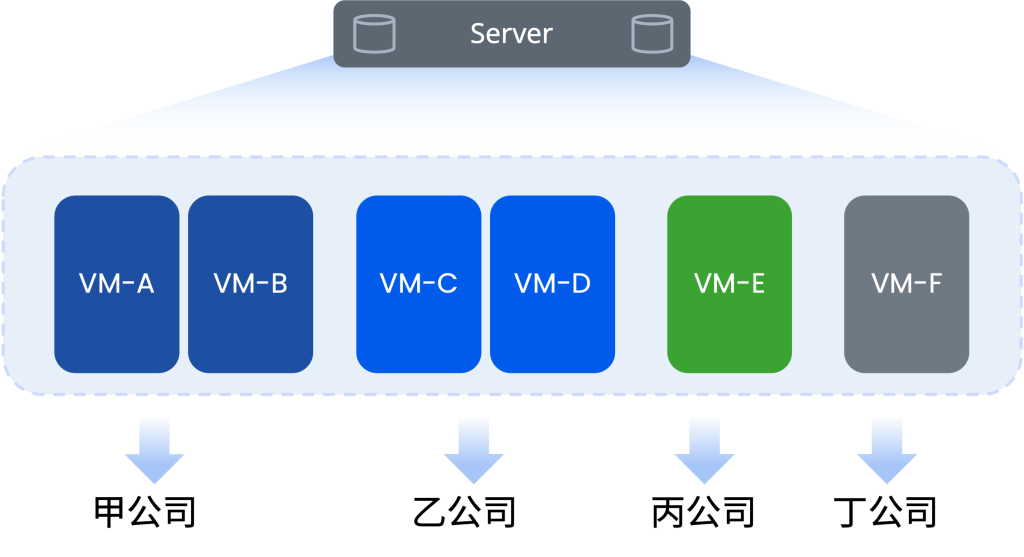

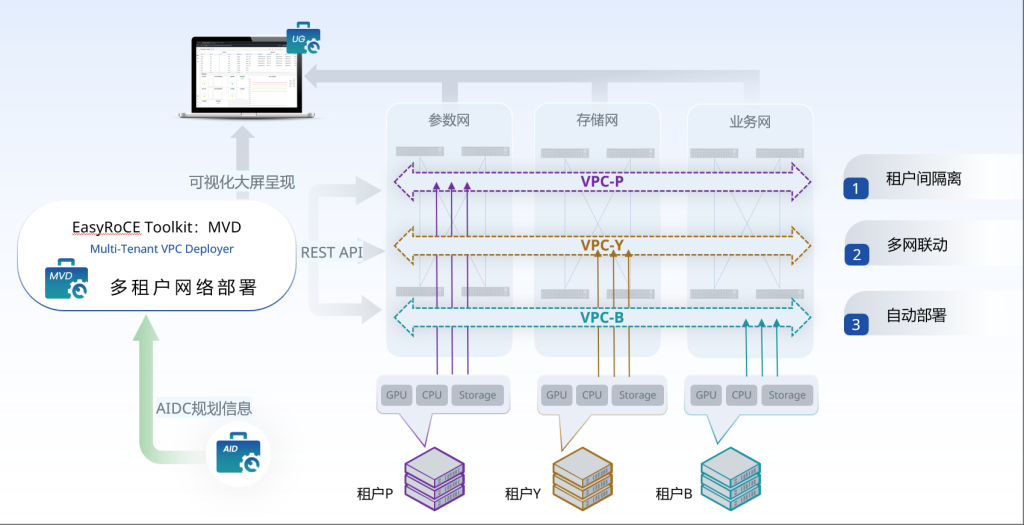

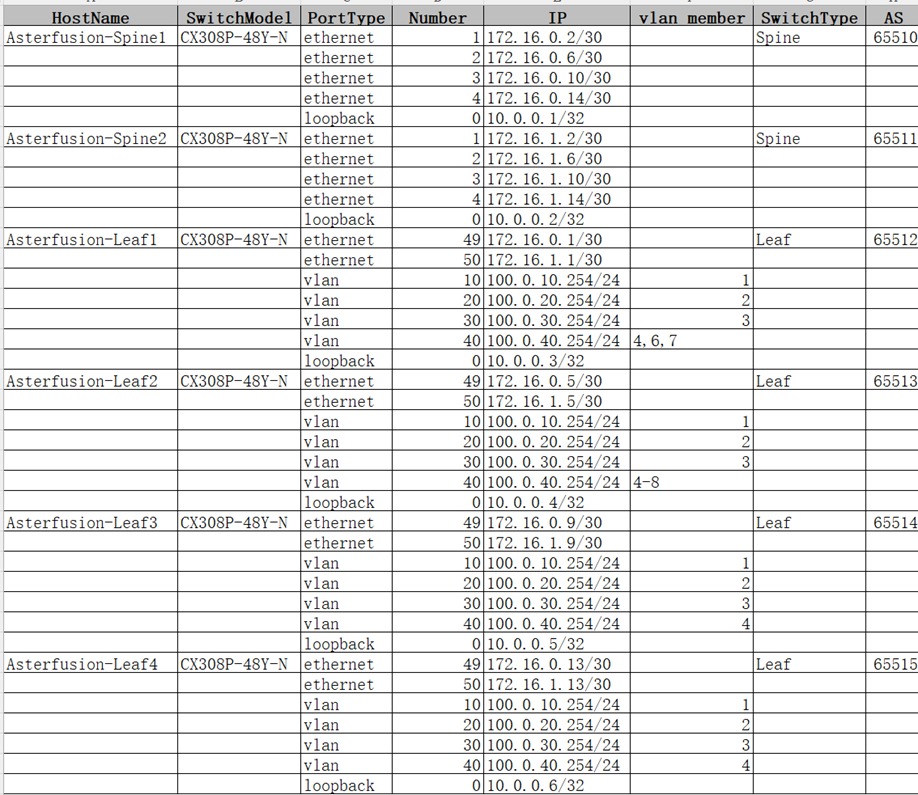

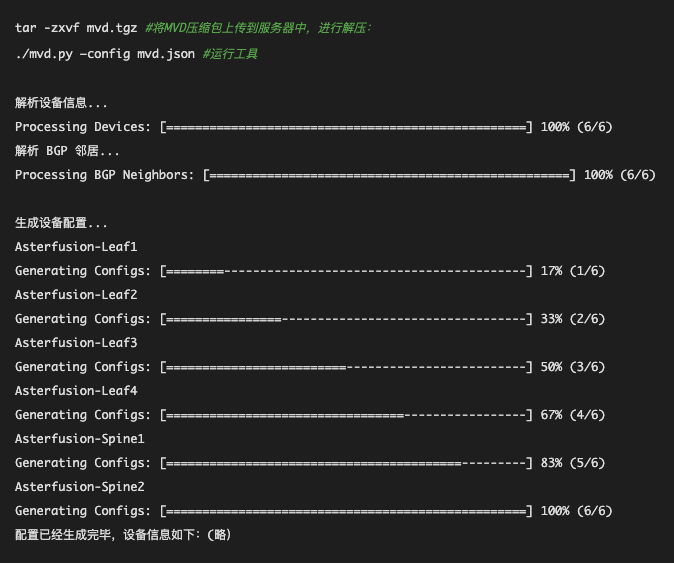

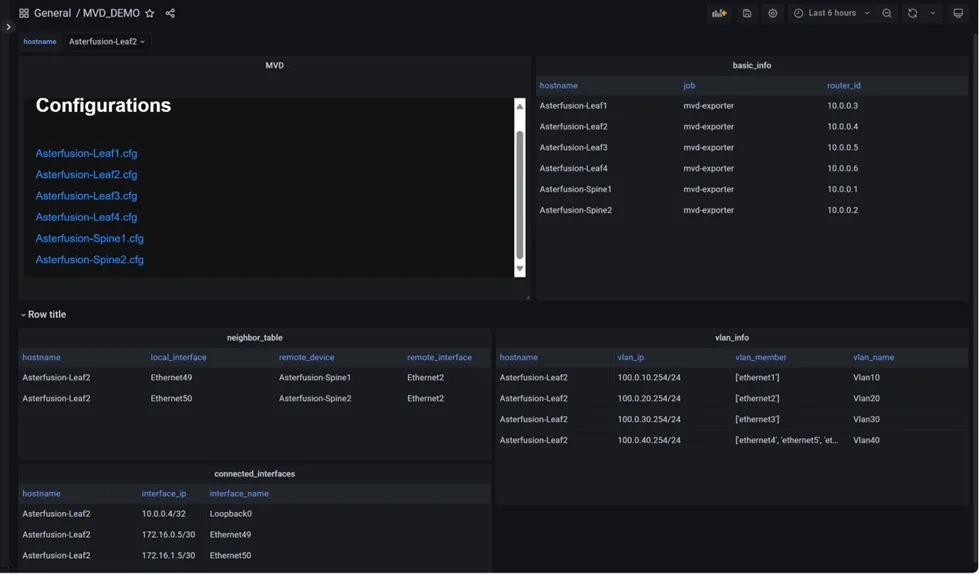

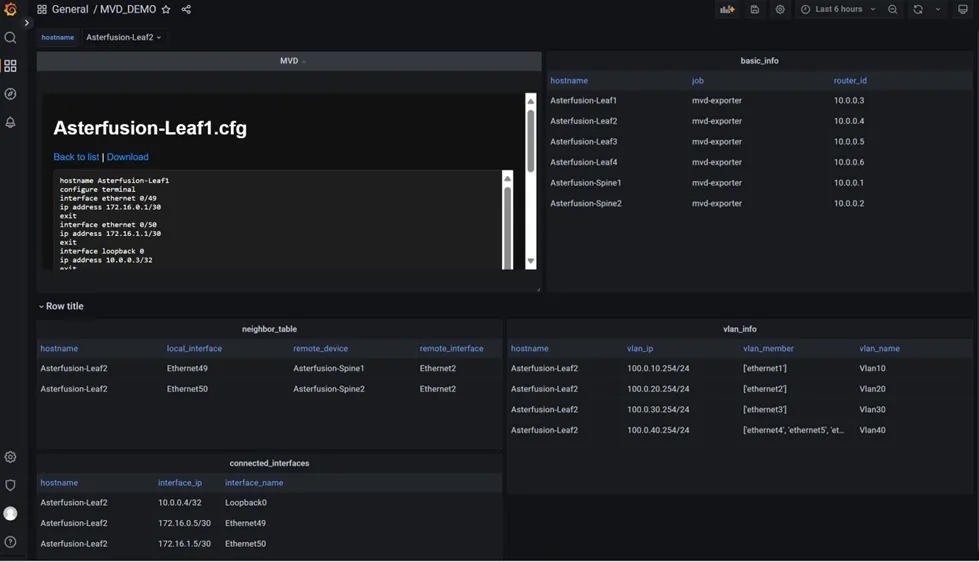

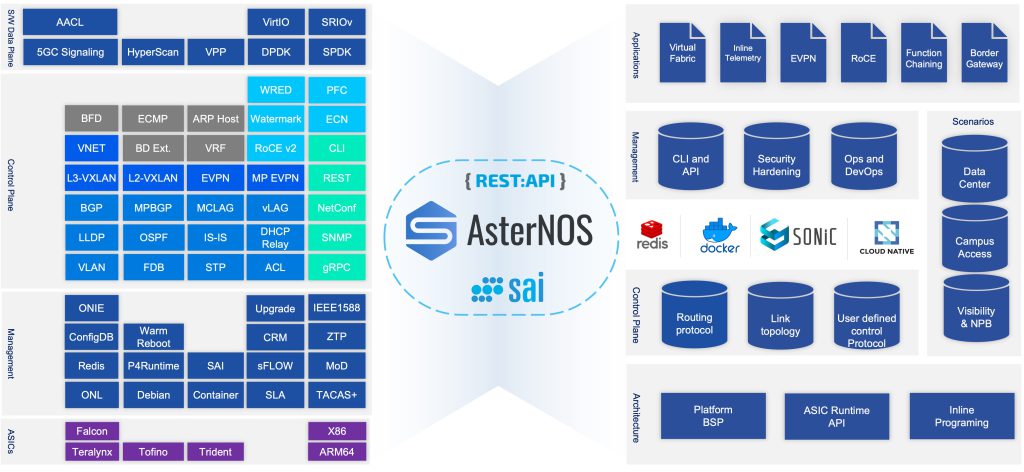

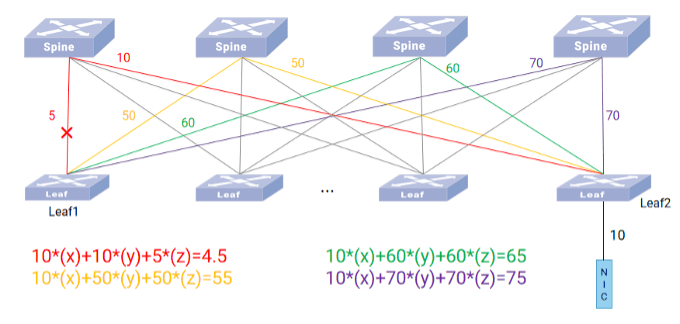

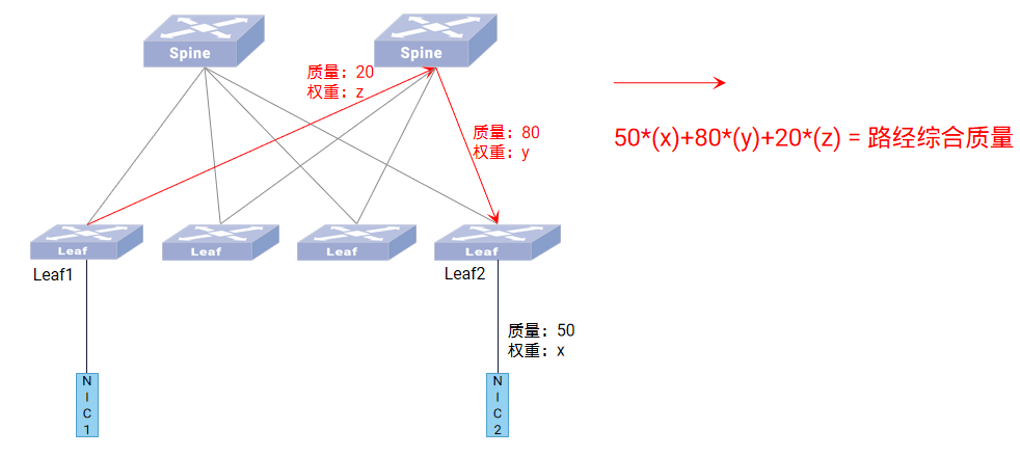

要想实现DCQCN,你的数据中心网络需要满足一些特定条件,并理解其三个核心组件(对应上图)的职责:

| 组件 | 角色与职责 | 硬件要求 |

|---|---|---|

| 交换机 (CP) | 监控出口队列长度,超过阈值时根据RED算法对数据包进行ECN标记。 | 支持ECN和RED功能的标准数据中心交换机。 |

| 接收端网卡 (NP) | 检测带有ECN标记的数据包,生成CNP拥塞通知包并返回给发送端。 | 支持RoCEv2的智能网卡 |

| 发送端网卡 (RP) | 根据收到的CNP包降低发送速率;在未收到CNP时逐步提升速率。 | 支持RoCEv2的智能网卡 |

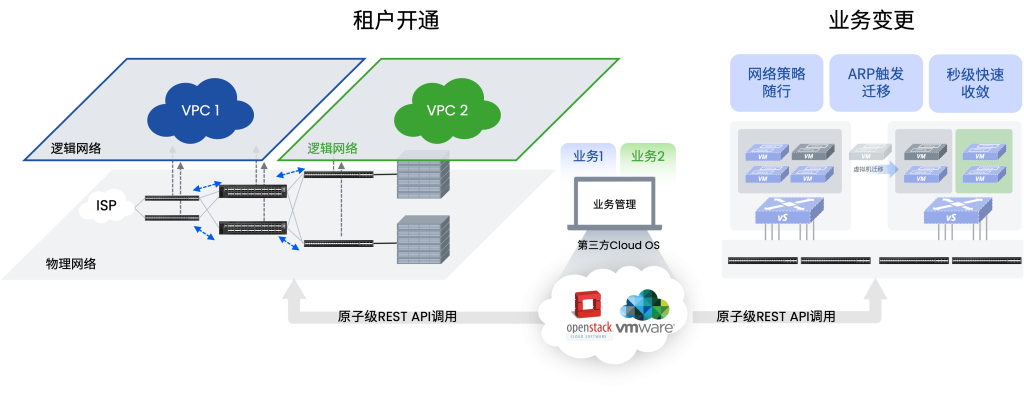

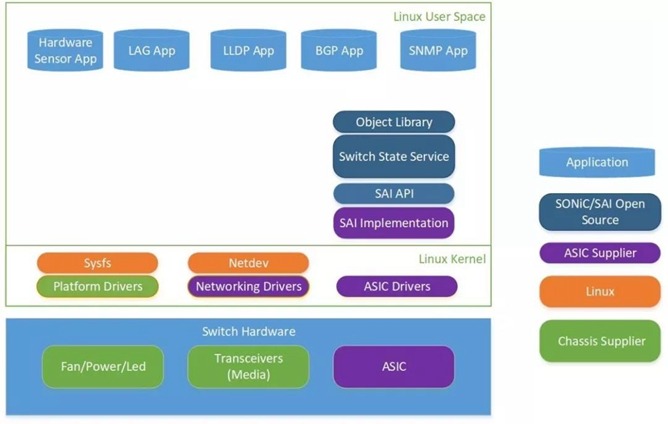

智算中心的硬件核心在于为 RoCEv2提供稳定、高性能的无损网络环境。这不仅需要网卡支持,更需要交换机的深度配合。CX-N系列数据中心交换机通过其超低时延、无损网络技术、对大容量缓存的优化、高级遥测功能以及对自动化运维的支持,为DCQCN协议在AI计算、高性能计算等场景中的高效、稳定运行提供了坚实的硬件基础。